Google 謹製の機械学習とファッションを組み合わせたデモ作品 Runway Palette がおもしろい!

Google ならではのデータ活用事例

今回ご紹介するのは、Google の Arts and Culture で公開されている WebGL と機械学習を活用したデモ作品です。

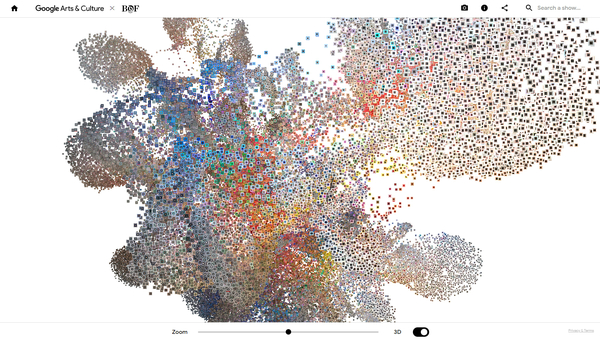

14 万以上の、ファッションショーにおけるランウェイ上のモデルの写真をデータソースに、それらを分類して 3D 空間上にマッピングした様子は非常に迫力があります。

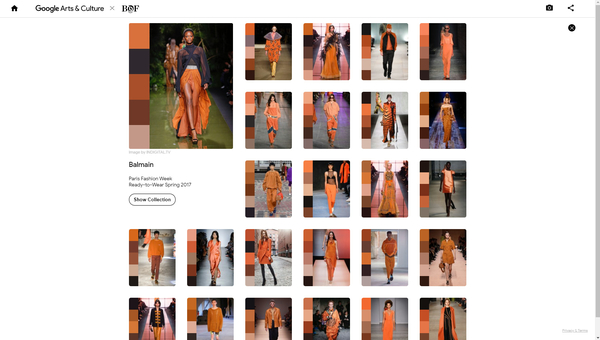

また、それぞれのパーティクルにデータが紐付いているので、詳細を見たり、似通っているものを探したりすることもできます。

リンク:

2D ベースで表示されているときも実際は 3D

今回の作品は、一応インターフェース上には「3D モードのオン・オフ」ができるトグルスイッチが置かれているものの、3D モードをオフにしたからといって 2D で描画が行われるわけではありません。

2D モードは、3D 空間上に配置されているパーティクルが XY 平面上にピッタリならぶことで、結果的に 2D 平面のように見せているだけですね。

画面下部のスライダーの操作や、マウスでのホイールスクロール操作でズーム率を変更することができ、全体を俯瞰して見ることもできます。

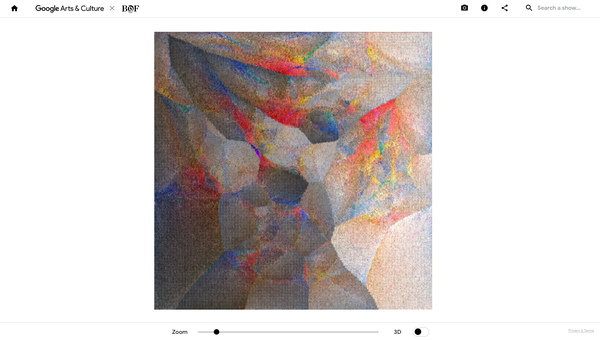

うーん、これだけを見てもなんだかアート作品のようで十分に味わい深いですね……

機械学習で分類した結果ということですが、こんな感じで可視化されると、自然界にあるような質感にも似た何か、をうっすら感じますね……なんとも不思議です。

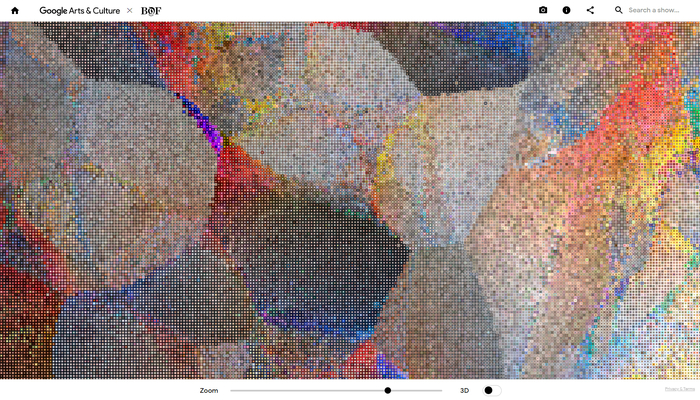

3D モードをオンにすると、一気にパーティクルが散らばって空間状を埋め尽くします。

この 3D モードの状態ではパーティクルを選択する操作が行えなくなってしまいますが、その代わりズームなどは行うことができるので、パーティクルの群れの中にカメラを突っ込んで、周囲をじっくりと観察することもできます。

3D モードをオフにしている状態なら、各パーティクルをクリックして選択することも可能です。

このとき、クリックされたパーティクルのカラーパレットが展開されると同時に、よく似たカラーパレットを持つ画像が抽出されます。

恐らく、これが機械学習で分類された結果を元にしたものなのでしょうね……

また、画像をアップロードして同じ分類エンジンに掛けることができるようになっており、試しにイクラ丼でやってみたら、なんとなくイクラ丼なファッションショーになりました。ありがとうございました。

14 万もの画像を分析するというと、普通の感覚からすると途方も無い作業のようにも思ってしまいますが、機械学習のデータソースとしては少ないくらいかもしれません……

私はそのあたり、門外漢なので詳しく評論することができないのですが、アップロードした写真も一瞬で解析されますし、Google らしい、腕力でぶん殴ってくるタイプの事例だなと思いました。

WebGL 的には、それほど特殊なことをやっているわけでもないのですが、見せ方としてはスマートかつキレイにまとまっていると思いますので、参考にしてみてください。

なかなか興味深い事例だと思いますので、ぜひチェックしてみてください。